代码能跑,人却看不懂,它到底经历了什么。

我最近在学编程,本来以为写完代码点运行就行了,结果发现事情没那么简单。电脑根本不懂我在写啥,它只认0和1,电流的开关而已。我们敲的那些if、for、print,在CPU眼里啥都不是。那这些代码是怎么变成程序跑起来的?我查了资料,越看越觉得离谱。

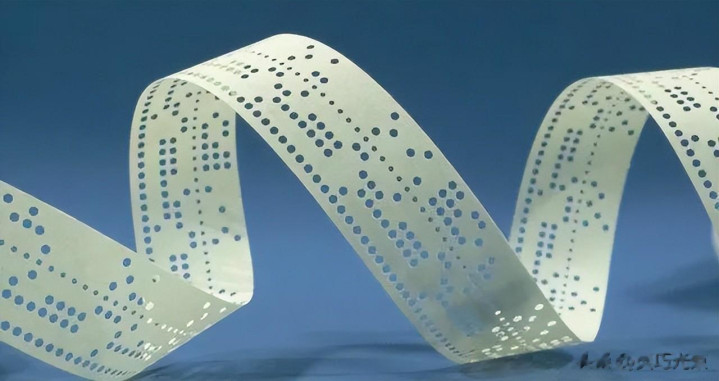

最早的程序员真狠,直接用手拨 switches 来输二进制。一个加法要按几十下,错一位全完蛋。那时候没有键盘,没有屏幕,连错误提示都没有。打孔纸带一卷,塞进机器,能跑就谢天谢地。谁能受得了这个?人不是机器,记不住一串串的11010010。

后来有人想了个招,用字母代替那些二进制。比如MOV代表搬数据,ADD代表加法。这叫汇编语言。看着好像好点,其实还是得管寄存器、地址这些破事。写个循环要手动算跳转位置,一个变量改了,下面七八处都得跟着调。累不说,一不小心就死循环了。

真正的转机是高级语言出现。Fortran第一个干这事,能让科学家直接写公式。X = Y + Z 这种,谁都能看懂。但它怎么变成机器能跑的东西?靠的是编译器。这个玩意像翻译,把你写的代码一步步拆解,最后喂给CPU。

编译器第一步是分词。比如你写 if (x > 5),它先拆成“if”、“左括号”、“x”、“大于”、“5”、“右括号”。跟读句子先分单词一样。这步叫词法分析,听着玄乎,其实就是切字符串。

接着是语法分析。它按一套规则把这些词串成树。比如if下面挂条件,条件下面挂判断内容,再往下是执行的语句。这棵树叫AST,抽象语法树。听起来挺学术,其实就是把代码结构画出来,方便下一步处理。

然后看语义对不对。比如你写 “abc” + 123,数字和文字相加,逻辑上说不通。这一步会报错。还会生成中间代码,一种谁都看得懂的“普通话”,不依赖具体哪种CPU。这样同样的代码,能在Intel也能在ARM上跑。

最后才是生成真正的机器码。根据中间代码,一条条对应成CPU指令。同时还会优化,比如删掉重复计算,把循环展开减少跳转。最终出一个.exe或者可执行文件。这时候电脑才能认。

整个过程像流水线,开云app每一步都不能错。错一个符号,编译失败。你写的代码可能只有十行,背后走的步骤可能是上千次操作。C语言、Python、Java,不管哪个语言,都绕不开这套流程。

现在语言越来越多,用途也越来越细。Python做AI,SQL查数据,JavaScript写网页。它们底层都得靠编译器或解释器转成机器能理解的东西。有些是提前编译好,有些是边跑边翻译。但原理差不多。

LLVM这个项目挺有意思。它把编译器拆开,前端处理语言,后端生成代码,中间搞优化。这样一来,不同语言可以共用一套系统。写个新语言也不用从头造轮子。技术堆着堆着,就成了基础设施。

可问题也不少。编译原理太难,学校里很多人一听就跑。能搞懂的人越来越少,老专家年纪大了,年轻人不愿意碰。企业招个懂编译的,比招算法工程师还难。有些开源编译器,几年都没人动一行。

{jz:field.toptypename/}

新硬件也带来麻烦。AI芯片、量子计算机,指令集和传统CPU不一样。老的编译器根本跑不了。得重新设计整套流程。语言也得跟着改,不然写出来的代码效率低得要命。

Rust这种语言开始强调安全和并发。它在编译时就检查内存错误,避免运行时崩溃。虽然写起来累一点,但系统级程序不敢出事。这种设计理念,正在影响新语言的发展。

AI也开始掺和进来。Copilot这种工具,能根据注释生成代码。你说“读取用户输入并判断是否大于10”,它真能写出一段Python。虽然不一定对,但至少能看出趋势——未来的代码,可能不用手写了。

但不管怎么变,核心没变。人类想得高,机器干得低。中间必须有人翻译。编程语言不是为了让机器舒服,是为了让人轻松。我们用几十年时间,建了这座桥,让它越来越宽,越来越稳。

那天我写了个简单的排序程序,点了运行。一秒不到结果出来了。以前觉得理所应当,现在我知道,这一秒里,我的代码被拆了又拼,翻译了四五遍,走过几万个逻辑节点。它不是自己跑起来的。

代码会动,是因为有人让它动。

备案号:

备案号: